阿里巴巴通义实验室推出多模态基础 GUI 智能代理系统 MAI-UI,在通用 GUI 基础操作和移动端 GUI 导航领域有显著突破,性能优于同类产品。它基于 Qwen3VL 架构,有不同参数规模版本,可接收自然语言指令和 UI 截图,输出结构化指令并执行多种任务,还能主动澄清需求、调用外部资源。技术上通过自我优化数据管道等确保稳定性。实测中,在 MobileWorld 等测试里任务成功率领先,为智能设备处理复杂操作提供高效方案。

阿里巴巴通义实验室近期正式推出了 MAI-UI——一款多模态基础 GUI 智能代理系统。该系统不仅支持人机交互,还集成了 MCP 工具应用、设备与云端协同以及在线强化学习功能,在通用 GUI 基础操作和移动端 GUI 导航领域取得了显著突破,性能表现优于 Gemini2.5Pro、Seed1.8 和 UI-Tars2 等同类产品。

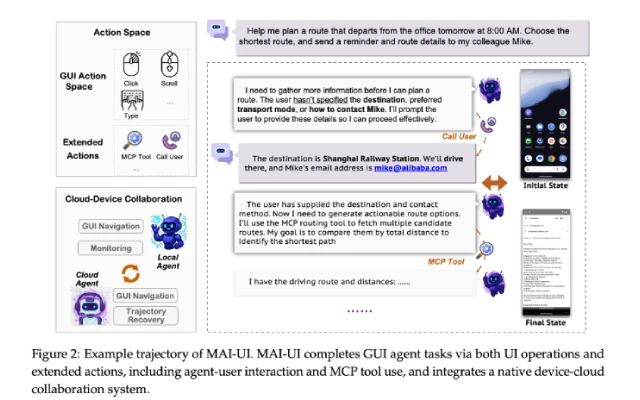

MAI-UI 基于 Qwen3VL 架构开发,提供 2B、8B、32B 和 235B 不同参数规模的模型版本。这些模型可接收自然语言指令和 UI 截图作为输入,输出结构化操作指令,并支持在实时 Android 环境中执行点击元素、滑动屏幕、文本输入和系统按钮操作等任务。此外,系统还具备主动澄清用户模糊需求的能力,可通过 MCP 工具调用外部资源,实现 GUI 操作、语言交互和 API 调用的混合执行。

在技术实现方面,MAI-UI 通过自我优化的数据管道和在线强化学习框架,确保导航功能的稳定性。Tongyi 实验室从应用手册、设计规范和公开数据中提取种子任务,经多智能体与人工标注员协同执行生成任务轨迹,持续优化导航策略。

实测数据显示,MAI-UI 在 MobileWorld 基准测试中取得 41.7% 的任务成功率,其最大规模版本在 AndroidWorld 测试中更达到 76.7% 的成功率,均领先于同类产品。

这一成果标志着移动应用领域 GUI 智能代理技术迈入新阶段,为智能设备处理复杂操作提供了更高效的解决方案。

Tongyi-MAI/MAI-UI: MAI-UI: Real-World Centric Foundation GUI Agents.